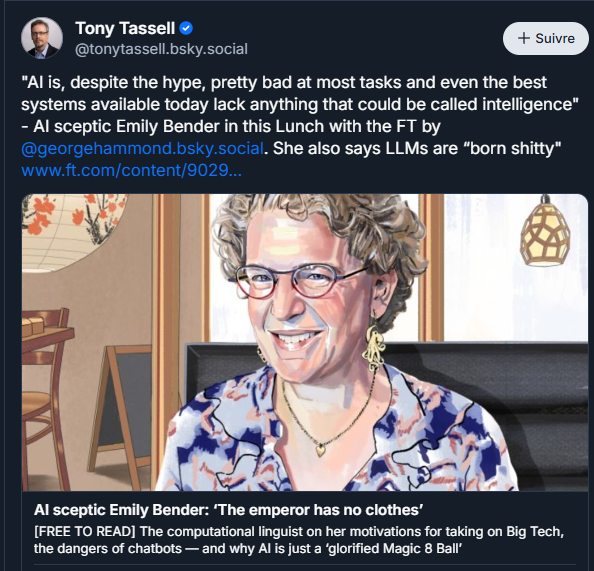

Critique du “hype” IA

Dans un article du Financial Times, Bender est présentée comme sceptique face à l’engouement autour des grands modèles de langage. Elle affirme que ces systèmes ne comprennent pas vraiment le langage et que les promesses de révolution technologique ou marketing industriel sont surévaluées. Nous pouvons déduire tout cela grâce à ce post X et à certains articles.